针对几种经典评价方法的缺点,通过引入人眼的主观特性,提出一种基于视觉感知与学习(visual perception and learning,VPL)的方法,以解决人类视觉系统(human vision system,HVS)多通道评价融合的不稳定性。借助反向传播(back propagation,BP)神经网络构建了评价融合模型,分别对几种视觉感知算法的多通道评价进行融合,并基于回归函数对视觉感知算法的结果进行二次互补融合。结果 表明,相对于现有主流方法,本文所提方法的各项评价指标均具有较大的优势。

Aiming at the shortcoming of several classical assessment methods, a new method of image quality assessment based on visual perception and learning(VPL), was proposed by introducing subjective characteristics of human eyes with a view to solving instability of multi-channel assessment pooling of the human vision system(HVS). Then, an assessment pooling model was constructed by virtue of the back propagation(BP)neural network, pooling multi-channel assessment of several visual perception algorithms. Finally, second complementary pooling was conducted for results of every visual perception algorithm based on the regression function. The experiment results show that every assessment indicator of the proposed method has greater advantages compared to the existing prevailing methods.

随着大数据和云计算等业务的兴起,图像信号获得了广泛的应用[1],因而基于计算机视觉原理的图像质量客观评价引起了人们的重视[2]。峰值信噪比(peak signal noise ratio,PSNR)是基于像素误差统计结果的经典算法,但其指标水平较低。近些年人们结合工程学和图像特征提出了一些新的评价算法,例如,结构相似度(structural similarity,SSIM)[3]是基于局部像素域相似度统计结果的工程方法,梯度相似度(gradient similarity mechanism,GSM)[4]则针对图像梯度特征进行相似度评价,而奇异值分解(singular value decomposition,SVD)[5]通过提取图像的奇异特征值进行误差评价。上述4种算法从评价准则和特征提取两方面构成了图像质量客观评价方法的基础,于是一些研究者针对这4种算法提出了改进的评价方法[6-9],但仍存在一些问题:各评价指标水平的差别较大,很难同时兼顾综合性能; 应用场景不同,各评价指标水平会出现较大的波动,稳定性较差。针对上述问题,本研究通过引入人类视觉系统(human vision system,HVS)显著感知特性提出了基于视觉感知与学习(visual perception and learning,VPL)的图像质量融合评价方法,即先构建反向传播(back prapagation,BP)神经网络融合模型对各算法的多通道评价结果进行融合,再基于回归函数对各算法的评价结果进行二次互补融合。

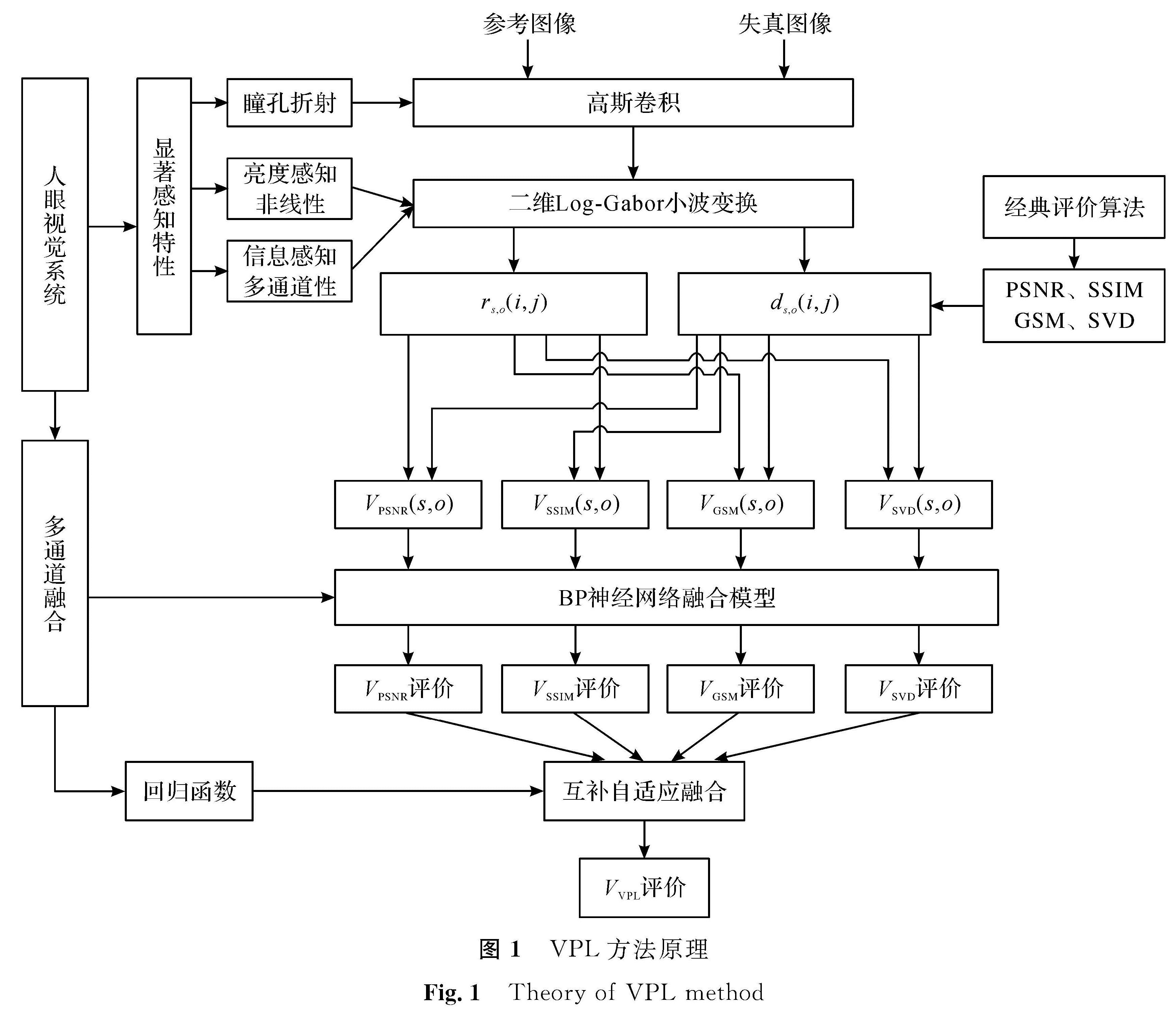

1 视觉感知与学习评价VPL方法的原理本研究提出的VPL方法的评价原理可用图1来描述,它充分利用了HVS视觉感知特性和视觉处理特性,首先对图像特征进行视觉处理; 然后对PSNR、SSIM、GSM和SVD 4种算法进行改进,提出了对应的视觉峰值信噪比(VPSNR)、视觉结构相似度(VSSIM)、视觉梯度相似度(VGSM)和视觉奇异值分解(VSVD)4种评价算法; 最后基于BP神经网络构建多通道评价融合模型,进而获得最终VVPL评价分值。VPL方法包括如下步骤:对参考图像r(i,j)和失真图像d(i,j)进行高斯卷积处理[3],模拟HVS瞳孔感光原理,(i,j)代表图像坐标点; 基于二维Log-Gabor小波变换算法[10]提取r(i,j)和d(i,j)的多通道视图rs,o(i,j)和ds,o(i,j),模拟HVS亮度感知非线性和信息多通道感知特性,参数s、o分别为

的尺度因子和方向因子; 设计VPSNR、VSSIM、VGSM和VSVD 4种改进的视觉评价算法,分别对ds,o(i,j)进行测量,获得视觉评价VPSNR(s,o)、VSSIM(s,o)、VGSM(s,o)和VSVD(s,o); 构建BP神经网络融合模型,分别通过VPSNR(s,o)、VSSIM(s,o)、VGSM(s,o)和VSVD(s,o)训练集的学习,依次获得对应测试集的融合结果VPSNR评价、VSSIM评价、VGSM评价和VSVD评价; 基于回归函数对所得结果进行逐步自适应融合,最终获得d(i,j)的VVPL评价分值。

1.1 视觉感知评价算法原理1.1.1 视觉峰值信噪比算法(VPSNR)基于PSNR算法及其改进算法[10],VPSNR评价公式如下:

VPSNR(s,o)=10log10((2552)/(Vmse(s,o)))。(1)

式(1)中:Vmse(s,o)为rs,o(i,j)和ds,o(i,j)的视觉均方误差,其定义如下:

Vmse(s,o)=1/L∑Lp=11/(MN)∑M-1i=1∑N-1j=1ω(i,j)[rs,o(i,j)-ds,o(i,j)]2。(2)

式(2)中:ω(i,j)为局部分块的高斯卷积核函数; MN为ω(i,j)的窗口尺寸,L为ω(i,j)的子块数量。

1.1.2 视觉结构相似度算法(VSSIM)基于SSIM算法[3]及其改进算法[11],VSSIM评价公式如下:

VSSIM(s,o)=1/L∑Lp=1[Hp(s,o)](α1)*[ζp(s,o)](α2)*[ψp(s,o)](α3)。(3)

式(3)中:一般取权重参数α1=α2=α3=1,Hp(s,o)、ζp(s,o)、ψp(s,o)的定义分别为

{Hp(s,o)=(2μr,p(s,o)μd,p(s,o)+C1)/(μ2r,p(s,o)+μ2d,p(s,o)+C1);

ζp(s,o)=(2σr,p(s,o)σd,p(s,o)+C2)/(σ2r,p(s,o)+σ2d,p(s,o)+C2);

ψp(s,o)=(2σr,d,p(s,o)+C3)/(σr,p(s,o)σd,p(s,o)+C3)。(4)

式(4)中:C1、C2、C3为稳定算法的常数; μr,p(s,o)、μd,p(s,o)为局部视觉高斯滤波均值; σr,p(s,o)、σd,p(s,o)为局部视觉高斯滤波均方差; σr,d,p(s,o)为局部视觉高斯滤波协方差,相关定义参见文献[7]。

1.1.3 视觉感知梯度相似度算法(VGSM)基于GSM算法[4]及其改进算法[12],VGSM评价公式如下:

{VGSM(s,o)=1/L∑Lp=1VGSM,p(s,o);

VGSM,p(s,o)=1/(MN)∑M-1i=1∑N-1j=1ω(i,j)(2gr(s,o)(i,j)gd(s,o)(i,j)+T)/(g2r(s,o)(i,j)+g2d(s,o)(i,j)+T)。(5)

式(5)中:VGSM,p(s,o)为局部视觉高斯滤波的梯度相似度评价; gr(s,o)(i,j)、gd(s,o)(i,j)分别为rs,o(i,j)和ds,o(i,j)的梯度特征视图,梯度算子参见文献[4]; T为稳定算法的常数。

1.1.4 视觉感知奇异值分解算法(VSVD)基于SVD算法[5]及其改进算法[13],所提VSVD评价公式如下:

{VSVD(s,o)=1/L∑Lp=1[VSVD,p(s,o)-Dmid(s,o)];

VSVD,p(s,o)={1/Z∑Zt=1[υr,t(s,o)-υd,t(s,o)]2}1/2。(6)

式(6)中:VSVD,p(s,o)为局部视觉高斯滤波的奇异值特征评价; Dmid(s,o)为VSVD,p(s,o)的中间值; υr,t(s,o)、υd,t(s,o)分别为rs,o(i,j)和ds,o(i,j)的第t个奇异特征值; Z为ω(i,j)窗口内的奇异特征值数量。

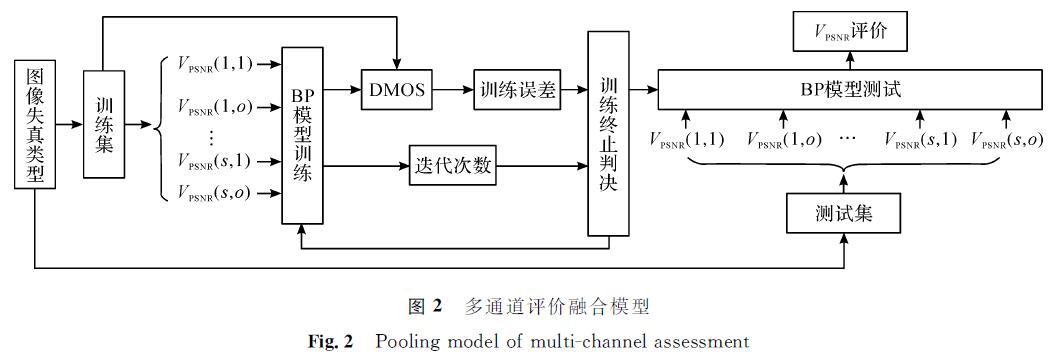

1.2 多通道评价融合原理HVS多通道融合对不同评价算法表现出不同的参数特性,目前尚未有相关的研究成果揭示HVS的多通道融合机制。本研究借助BP神经网络解决HVS多通道融合的不稳定性问题,构建了相应的HVS多通道融合模型,依据图像失真类型的不同将数据库中的失真图像数量随机对半分为训练集和测试集两部分。BP神经网络融合模型为图2所示的典型三层结构[14],其中,输入层神经元数量为通道数s*o=5*4=20,隐藏层神经元数量为20,输出层神经元数量为1,以学习误差e≤0.01和迭代次数ρ=200作为该模型的训练终止判决条件。BP融合模型的训练阶段首先选取一种图像失真类型和一种视觉评价算法(以VPSNR为例),将训练集中所有失真图像的VPSNR(s,o)分值作为模型的训练输入,以差异均值主观分(difference mean opinion score,DMOS)为训练目标,对模型进行训练,当达到其中一个训练终止条件e≤0.01或ρ=200时终止训练,转入测试阶段。BP融合模型的测试阶段选取对应训练阶段同一失真类型图像的VPSNR(s,o)分值作为模型的输入,模型的输出即为VPSNR(s,o)的融合结果分值VPSNR。依次选取不同的图像失真类型和不同的评价算法进行训练,分别获得对应图像失真类型和对应评价算法的多通道融合评价结果分值。

1.3 自适应融合原理

根据VPSNR、VSSIM、VGSM和VSVD的评价结果,基于回归函数将其进行自适应融合[14],得最终结果VVPL分值如下:

VVPL=[(V(1-λ1)(PSNR)V(λ1)(SSIM))1-λ2V(λ2)(GSM)]1-λ3V(λ3)(SVD)。(7)

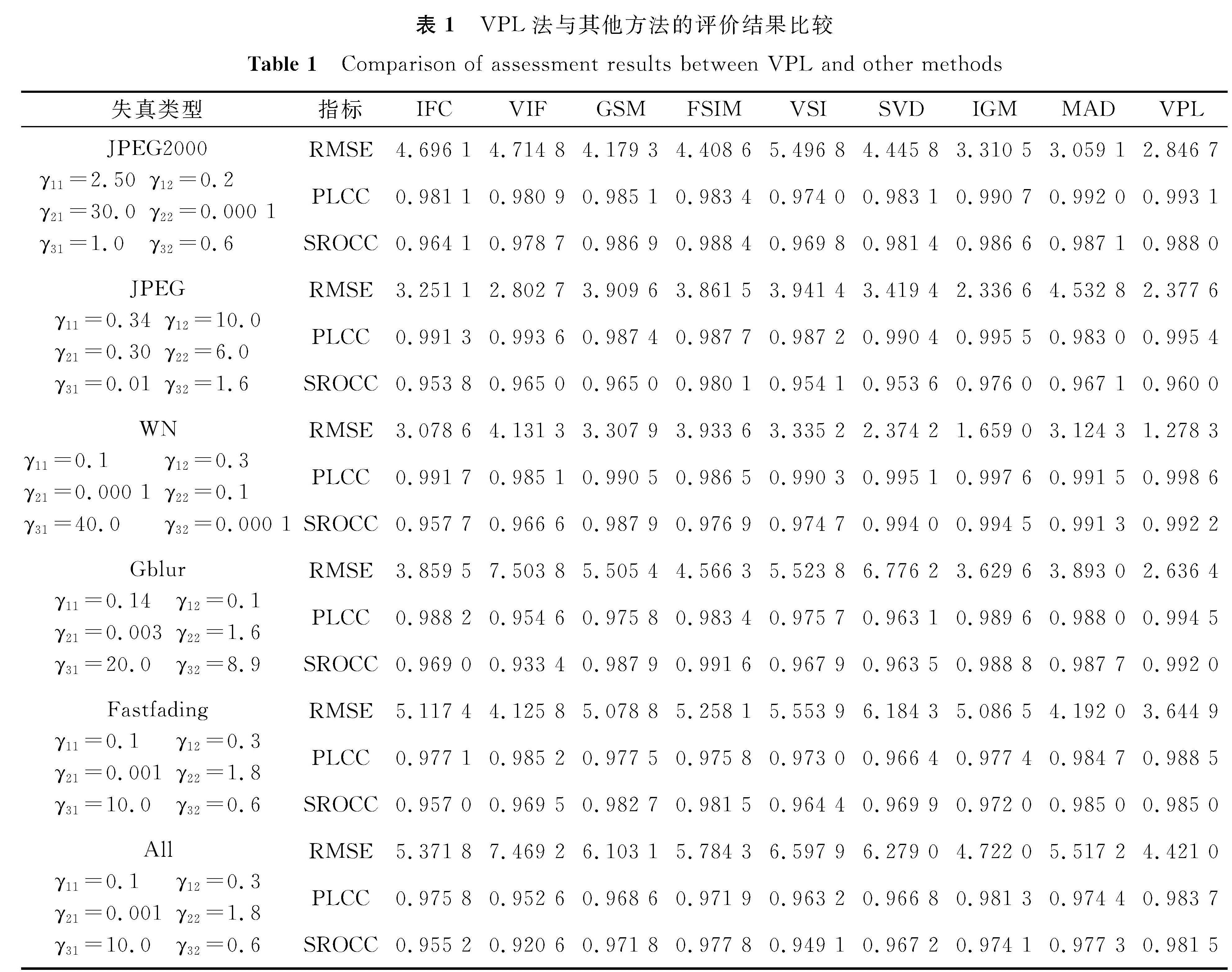

式(7)中:λ1=1/[1+γ11V(γ12)(SSIM)],λ2=1/[1+γ21V(γ22)(GSM)],λ3=1/[1+γ31V(γ32)(SVD)],参数γ11、γ12、γ21、γ22、γ31和γ32根据经验和试验训练取值,参见表1。

2 结果分析2.1 VPL方法结果分析基于LIVE(database release2)数据库的试验结果如表1所示,试验挑选了近年来的主流方法进行比较,其中,特征相似度(feature similarity,FSIM)[6]和视觉显著索引(visual saliency index,VSI)[7]基于视觉特征评价原理,信息保真度(information fidelity criterion,IFC)[8]和视觉信息保真(visual information fidelity,VIF)[9]基于信息评价原理,显著失真(most apparent distortion,MAD)[15]和内推机制(internal generative mechanism,IGM)[16]基于视觉心理评价原理。表1的试验结果表明本研究VPL方法的优势,体现在:1)所有失真类型评价的均方根误差(root mean square error,RMSE)和皮尔逊线性相关系数(Pearson linear correlation coefficient,PLCC)两项指标均具有较高的水平,RMSE小于3.663 4,PLCC大于0.988 3,明显优于其他方法。2)斯皮尔曼阶相关系数(Spearman rank-order correlation coefficient,SROCC)指标在JPEG2000、WN、gblur和fastfading多个失真类型上均有较大的优势。3)本方法的3项指标对各种失真类型评价都保持了非常稳定的高水平,RMSE小于等于3.663 4,PLCC大于等于0.988 3,SROCC大于等于0.960 0,没有出现明显的下降,而其他方法均有一定程度的下降。4)对各种失真类型的总体(All)评价上,本方法的3项指标水平具有明显优势,RMSE为4.421 0,PLCC为0.983 7,SROCC为0.981 5。综上,本研究VPL方法相比其他方法具有较高的准确度和稳定性。

2.2 算法复杂度测试

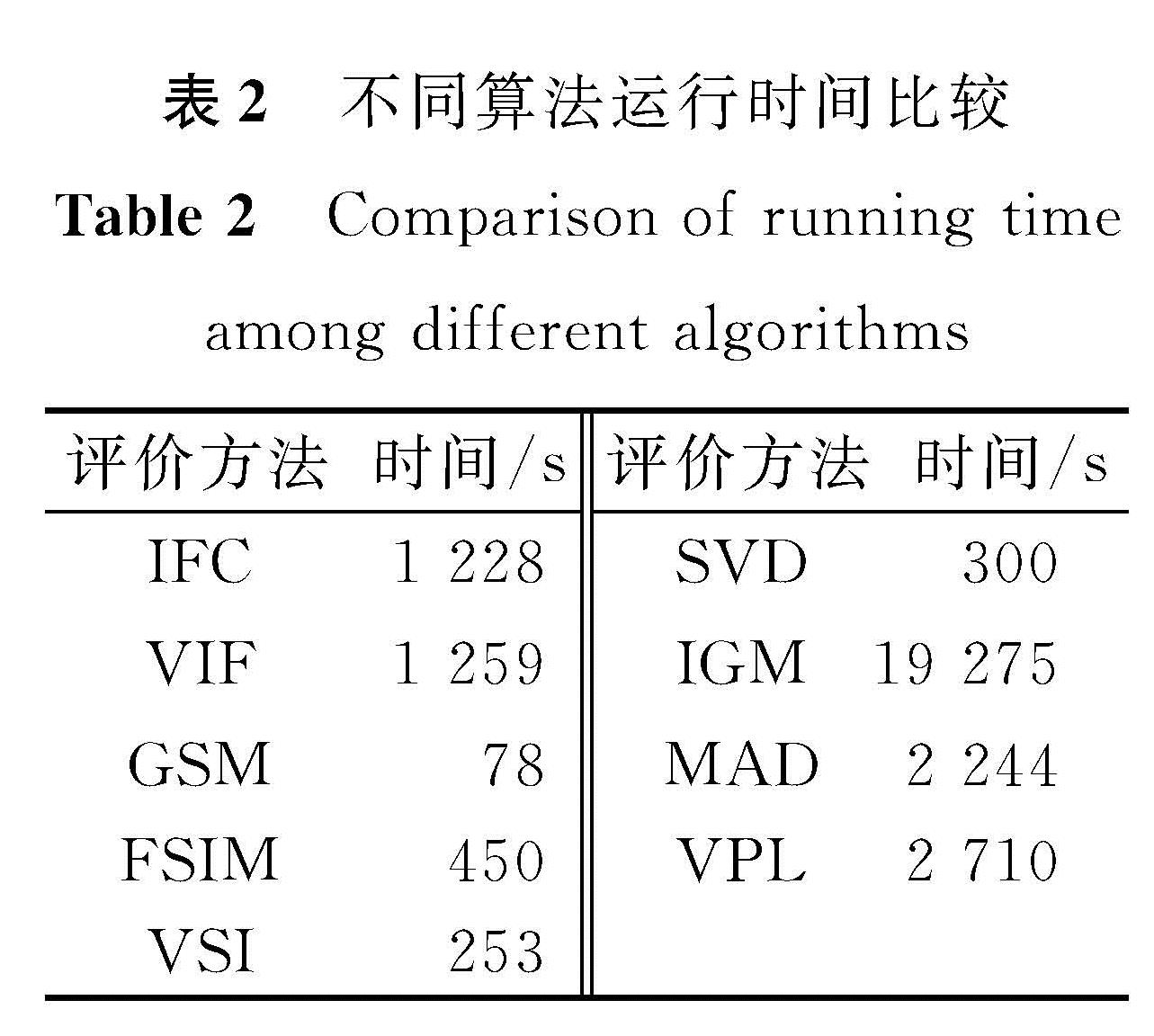

本试验测试了上述方法的运行时间,结果如表2所示,测试平台为i7-7500U CPU@2.70 GHz、8 G内存的L470便携式PC、Windows10、MATLAB R2014a。表2中数据说明,与基于视觉神经理论的同类方法IGM、MAD相比,本研究VPL方法的运行时间与MAD基本上相当,但明显优于IGM方法。

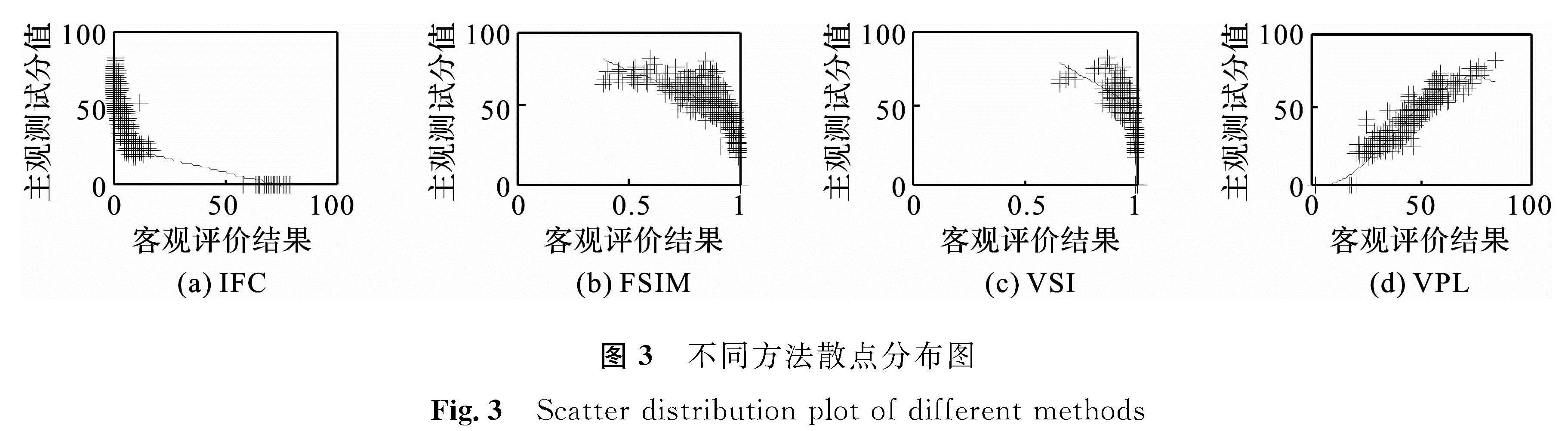

图3(a)~(d)分别为IFC、FSIM、VSI和VPL方法的散点分布图,其中,VPL方法的客观评价结果均匀地分布在[0,100]区间内,这表明它具有最高的分辨率和线性度。

3 结 语

针对PSRN、SSIM、GSM和SVD主流评价方法的不足,本研究通过引入HVS的显著感知特性对其进行了改进,并借助于BP神经网络的学习推理能力对HVS的多通道评价进行了融合,解决了HVS中多通道评价融合的不稳定性问题。试验结果表明我们所提方法具有较高的准确度和稳定性,因而具有一定的参考价值。

- [1] GUO Y C, HAO Y T, YU M. Image retargeting quality assessment based on content deformation measurement[J]. Signal Processing:Image Communication,2018,67(6):171.

- [2] ZHANG Y B, LIN W S, LI Q H, et al. Multiple-level feature-based measure for retargeted image quality[J]. IEEE Transactions on Image Processing,2018,27(1):451.

- [3] WANG Z, BOVIK A C, SHEIKH H R, et al. Image quality assessment: from error visibility to structural similarity[J]. IEEE Transactions on Image Processing,2004,13(4):600.

- [4] LIU A M, LIN W S, NARWARIA M. Image quality assessment based on gradient similarity[J]. IEEE Transaction on Image Processing,2012,21(4):1500.

- [5] SHNAYDERMAN A, GUSEV A, ESKICIOGLU A M. An SVD-based grayscale image quality measure for local and global assessment[J]. IEEE Transactions on Image Processing,2006,15(2):422.

- [6] ZHANG L, ZHANG L, MOU X Q, et al. FSIM: a feature similarity index for image quality assessment[J]. IEEE Transaction on Image Processing,2011,20(8):2378-2386.

- [7] ZHANG L, SHEN Y, LI H Y. VSI: a visual saliency induced index for perceptual image quality assessment[J]. IEEE Transactions on Image Processing,2014,23(10):4270.

- [8] SHEIKH H R, BOVIK A C, DE VECIANA G. An information fidelity criterion for image quality assessment using natural scene statistics[J]. IEEE Transactions on Image Processing,2005,14(12):2117.

- [9] SHEIKH H R, BOVIK A C. Image information and visual quality[J]. IEEE Transactions on Image Processing,2006,15(2):430.

- [10] 丰明坤,赵生妹,邢超.一种基于视觉特性的PSNR图像评价方法[J].南京邮电大学学报(自然科学版),2015,35(8):35.

- [11] 丰明坤,赵生妹,邢超.基于视觉显著失真度的图像质量自适应评价方法[J].电子与信息学报,2015,37(9):2064.

- [12] 丰明坤,赵生妹,施祥.视觉多通道梯度与低阶矩自适应图像评价[J].仪器仪表学报,2015,36(11):2533.

- [13] 丰明坤,王中鹏,叶绿.视觉稀疏化多通道多特征自适应的图像评价[J].仪器仪表学报,2016,37(3):669.

- [14] 丰明坤,施祥.视觉特征深度融合的图像质量评价[J].浙江大学学报(工学版),2019,53(3):516.

- [15] LARSON E C, CHANDLER D M. Most apparent distortion: full-reference image quality assessment and the role of strategy[J]. Journal of Electronic Imaging,2010,19(1):011006-1.

- [16] WU J J, LIN W S, SHI G M, et al. Perceptual quality metric with internal generative mechanism[J]. IEEE Transactions on Image Processing,2013,22(1):43.

图 2 多通道评价融合模型

Fig.2 Pooling model of multi-channel assessment

图 2 多通道评价融合模型

Fig.2 Pooling model of multi-channel assessment